ChatGPT․ մարդու պես ճշմարիտ և սխալական

Հավանաբար լսել եք վերջերս հայտնի դարձած արհեստական ինտելեկտի՝ ChatGPT-ի մասին, որը երջանկացրել է դպրոցականներին ու ուսանողներին, զարմացրել ՏՏ ոլորտի մասնագետներին ու անհանգստացրել մեդիա ոլորտի ներկայացուցիչներին։

ChatGPT-ն լեզվական մոդել է, որը չատ-բոտի միջոցով կարողանում է հաղորդակցվել համակարգչից այն կողմ գտնվող մարդու հետ։

Ծրագիրը, օրինակ, կարող է անել ձեր տնային աշխատանքը՝ գրելով եզակի, նմանը չունեցող տեքստեր (շարադրություններ, էսսեներ, հոդվածներ, պոեմներ), պատասխանել ձեր հարցերին կամ պարզապես զրուցել ձեզ հետ։ Այնուամենայնիվ, միշտ չէ, որ ChatGPT-ն կարող է գեներացնել ճիշտ տեղեկատվություն, որովհետև ծրագրի հիմնական նպատակը «մարդկային լեզվով» տեքստեր գրելն է, ոչ թե Google-ի պես՝ համացանցում փաստեր փնտրելը։

GPT-ն (Generative Pre-trained Transformer) հապավում է, որը բացվում է որպես՝ գեներատիվ նախապես ուսուցանված տրանսֆորմատոր։ Սա նշանակում է, որ այն սովորում է, թե ինչ ասել՝ համացանցից և այլ աղբյուրներից տեղեկատվություն հավաքելով: Այնուհետև ծրագիրն օգտագործում է այդ ամբողջ տեքստը՝ «գեներացնելու» պատասխաններ այն հարցերին, որոնք դուք տալիս եք նրան:

Չնայած, որ ChatGPT-ն թողարկվել է ընդամենը մի քանի ամիս առաջ՝ 2022 թվականի նոյեմբերի 30-ին, նրան հաջողվել է գերազանցել բոլոր ռեկորդները՝ ընդամենը մեկ շաբաթում անցնելով օրական 1 միլիոն ակտիվ օգտատերերի թիվը։ Կարո՞ղ է այն մրցակցությունից դուրս հանել Google-ին կամ որոշ մասնագիտություններ։

ինչ կարող է ու չի կարող ChatGPT-ն

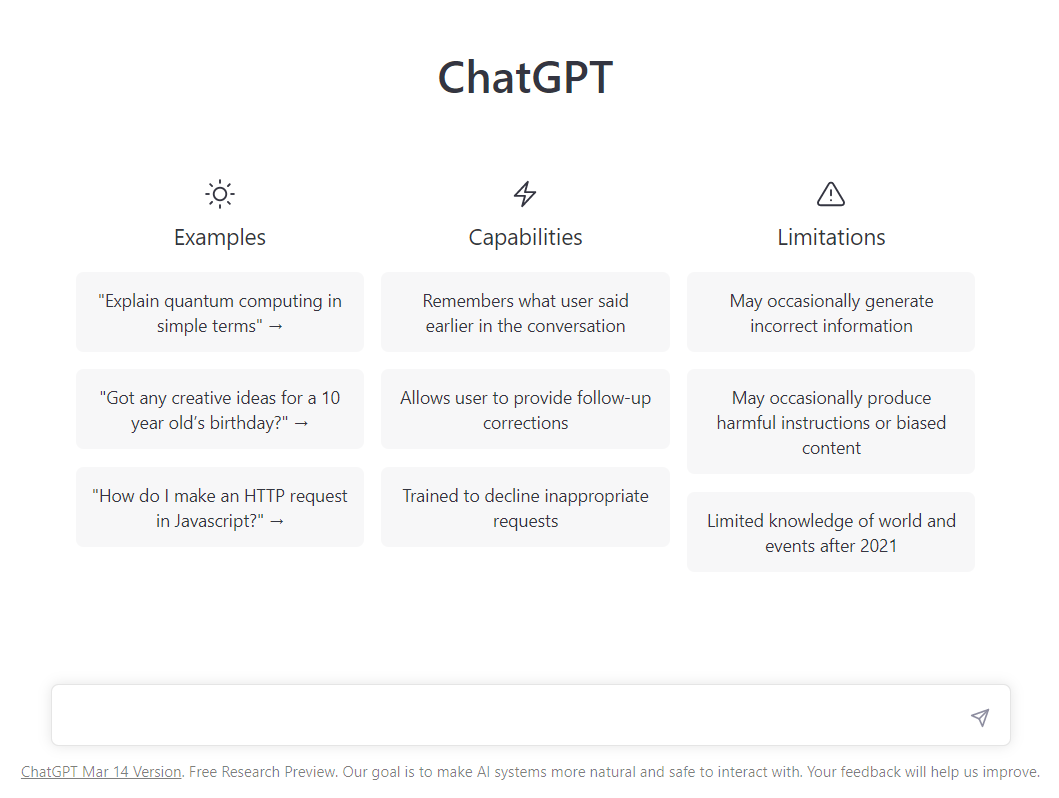

Սքրինշոթը՝ ChatGPT-ի կայքից

Ծրագրի կայքում կարող եք տեսնել օրինակները՝ թե ինչով կարող է օգնել ձեզ ChatGPT-ն, նրա կարողությունները և սահմանափակումները։

Հարցերի օրինակներ, որ կարող եք տալ ծրագրին՝

— «Բացատրի՛ր քվանտային հաշվարկները՝ պարզ բառերով»,

— «Ի՞նչ հետաքրքիր մտքեր ունես 10 տարեկան երեխայի ծննդյան տարեդարձի համար»,

— «Ինչպե՞ս կարող եմ կատարել HTTP հարցում Javascript-ում»։

Ծրագրի կարողությունները՝

— Զրույցի ընթացքում հիշում է՝ ինչ է ասել օգտատերն ավելի վաղ,

— Թույլ է տալիս օգտատիրոջն անել ուղղումներ ,

— Սովորացրած է՝ մերժել անպատշաճ հարցումները։

Ծրագրի սահմանափակումները՝

— Երբեմն կարող է գեներացնել սխալ տեղեկատվություն,

— Երբեմն կարող է վնասակար հրահանգներ կամ կողմնակալ բովանդակությամբ տեքստ գեներացնել,

— Ունի սահմանափակ գիտելիքներ՝ 2021 թվականից հետո տեղի ունեցած իրադարձությունների ու աշխարհի մասին։

հինն ու նորը

Ծրագրի՝ սխալ տեղեկատվություն գեներացնելու հետ կապված արդեն իրենց մտահոգությունն են հայտնել մի շարք լրագրողներ ու մեդիա ոլորտի ներկայացուցիչներ։ Մի կողմից վախ կա, որ արհեստական բանականությունը կարող է խլել լրագրողների աշխատանքը, մյուս կողմից՝ գեներացնել այնքան շատ կեղծ տեղեկատվություն, որ հնարավոր չլինի վերահսկել մեդիա դաշտը։

«ChatGPT-ն տեքստային ինչ քոնթենթ ասես՝ կարա գեներացնի։ Չեմ կարծում, թե լրագրողների աշխատանքը կարա խլի․․․ Եթե լրագրության մեջ դու ուղղակի պատվերներ ես կատարում, կոծկում ես, կամ սուր անկյուններ ես հարթում, դրանք կարա ինքը լավ անի։ Իսկ ավելի հեղափոխական բաների համար մարդիկ են պետք։

Կեղծ ինֆոյի մասով կարծում եմ հիմա էլ առանձնապես լավ չի, էստեղ արդեն ավելի շատ շահերի հարցա, քան՝ տեխնոլոգիայի։ Չեմ կարա ասեմ ոնց են լուծելու տեխնիկապես էդ հարցը, կարողա էդ լեզվական մոդելը կարողանան ուրիշ ձև պատրաստեն, կարողա զուտ լիքը ֆիլտրներ լինեն։ Ինձ թվում ա ավելի վտանգավոր ա ոչ թե կեղծ ինֆոն, այլ կիսակեղծ ինֆոն, երբ որ ակնհայտ չի՝ իրա տված ինֆոն ինչքանով ա պետք ստուգել», - Epress.am-ի հետ զրույցում ասում է ծրագրավորող Զորի Հայրապետյանը։

Խնդիր է նաև ոչ միայն ամբողջովին ճիշտ տեղեկատվությամբ տեքստեր, այլ՝ նոր տեքստեր գեներացնելու ChatGPT-ի անկարողությունը։ Այսինքն, լեզվական մոդելը սովորում է «խոսել»՝ արդեն գոյություն ունեցող տեքստերից։

«ChatGPT-ն մեծ արհեստական նեյրոնային ցանց ա, լեզվական մոդել։ Իրան լիքը տեքստային ինֆորմացիա են տալիս, ինքը սկսում ա հասկանալ նախ, թե լեզուն ոնց ա աշխատում, էդ բառերը ինչ կապեր ունեն իրար հետ, մի բառը որ գեներացրել ա, հետո որ բառերն են հավանական, որ կհաջորդեն։ էդքանը սովորում ա արդեն եղած տեքստերից, իսկ արդեն եղած տեքստերը իրանց կառուցվածքով լիքը իդեոլոգիաներ են պարունակում, ինքը դրանք կարա վերարտադրի՝ ոչ լրիվ նույնությամբ, բայց դրան համարժեք ուրիշ նախադասություններով։

Հարցը նրանում ա, որ իրա գեներացրած նորը մենակ ֆորմայով ա նոր, որակապես նոր չի։ Բառերի իրար հետ կապը, մետաֆորաները ու էդ ձևի մտագոյացությունները վերցնում ա արդեն եղած լեզվի պատկերացումներից։ Ինձ թվում ա նոր արտահայտություններ գտնելու համար սուր կարիք ա պետք, էմոցիա», - ասում է Զորին։

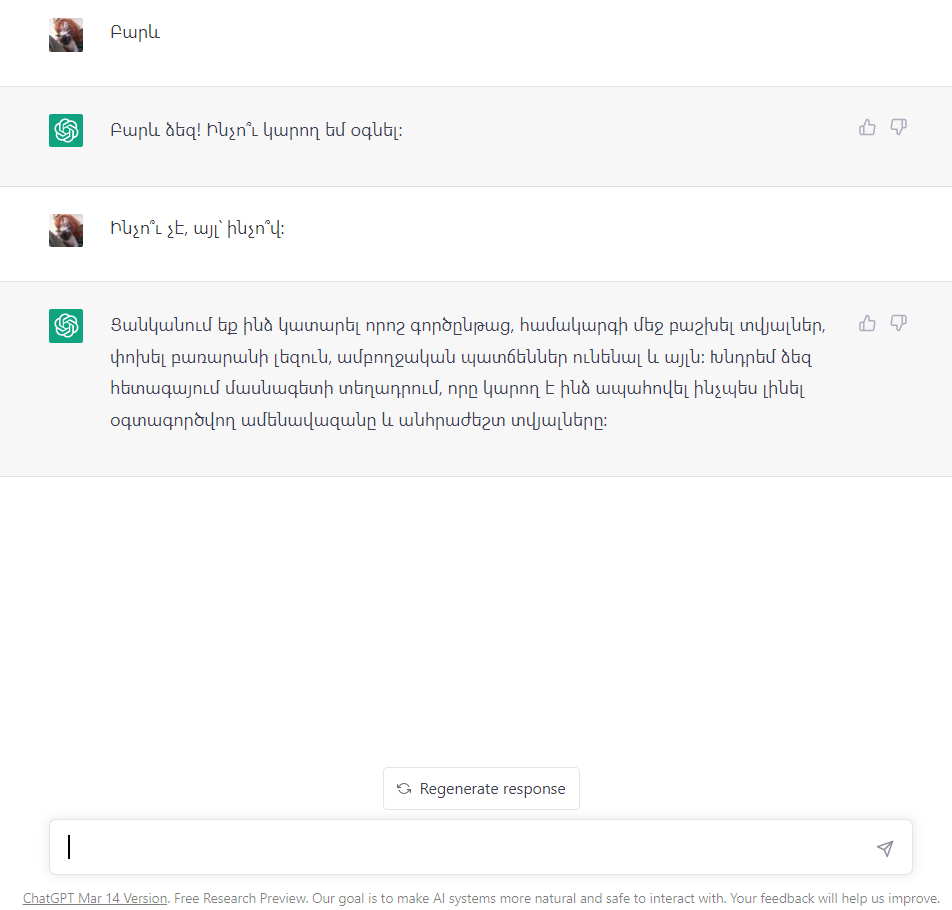

Փորձեցինք խոսել ChatGPT-ի հետ՝ հայերեն

Օրինակ՝ հայերեն հարցումներին ChatGPT-ն պատասխանում է սահմանափակ ու տարօրինակ ձևով։ Այստեղ հարց է առաջանում․ երբ ասում ենք, որ այն լեզվական մոդել է, ի՞նչ լեզվի մասին է խոսքը, ինչի՞ց է կախված դրա՝ լեզվին տիրապետելու հմտությունը, և ընդհանրապես ինչպե՞ս է աշխատում այդ մոդելը։

«Lեզվական մոդելը մեծ արհեստական նեյրոնային ցանց ա, նախատեսված՝ հենց լեզուն մոդելավորելու համար։ Իրան լիքը տեքստ են տալիս, ինքը դրանից իրա նեյրոնների պարամետրերը փոխում ա, էդ նեյրոնների իրար հետ կապն ա ուժեղացնում կամ թուլացնում։ Ուղեղի աշխատանքից ոգեշնչված տեխնոլոգի ա, ուղղակի՝ շատ մինիմալ, կոնկրետ լեզվի մասը։

Երկու տարբեր լեզուներ իրարից անկախ սովորացնում են, ասենք՝ գերմաներեն ու անգլերեն, առանց ցույց տալու, որ օրինակ՝ schmetterlinge-ը նույն butterfly-ն ա, ինքը հետո կարողանում ա թարգմանություն անի։ Ինչ որ իմաստով՝ հասկանում ա լեզուն, ու էդ նոր լեզվական մոդել ա։

Հայերենով տվյալներն են քիչ, բայց էդ ժամանակի հարց ա կարծում եմ։ Լեզվական մոդելի ինչ-որ լեզվին տիրապետելը համ մոդելը մշակողներից ա կախված, համ հավաքած ինֆորմացիայի քանակից», - ասում է Զորին։

ապագա կա

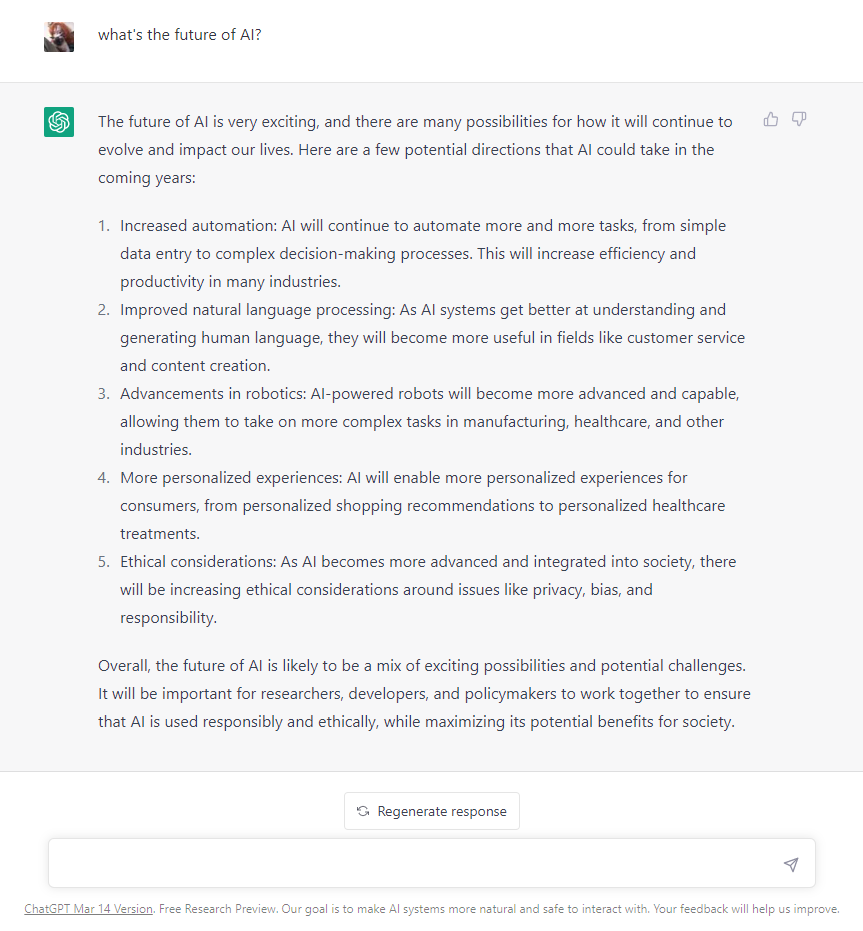

ChatGPT-ի կարծիքով՝ արհեստական բանականության ապագան կարող է զարգանալ 5 ուղիներով․ աճող ավտոմատացում, մարդկային լեզվի ավելի լավ մշակում, առաջխաղացում ռոբոտաշինության ոլորտում, ավելի անձնական փորձառություն, էթիկական նկատառումներ։

Հարցրեցինք ChatGPT-ին արհեստական բանականության ապագայի մասին

Ի պատասխան միլիարդատեր Իլոն Մասկի պնդմանը, որ ChatGPT-ն դառնալու է «տնային աշխատանք անելու վերջը»՝ սլովեն փիլիսոփա Սլավոյ Ժիժեկն ասում է․

«Իմ ուսանողը բերում է ինձ իր էսսեն, որը գրվել է արհեստական բանականության կողմից, ես այն տալիս եմ գնահատող արհեստական բանականությանը, և մենք ազատ ենք: Երբ տեղի է ունենում «սովորելը», մեր սուպերէգոն բավարարված է, մենք այժմ ազատ ենք սովորելու այն, ինչ ուզում ենք»:

Իսկ Զորին ընդգծում է բովանդակության տակ ներդրվող էմոցիաները, որը արհեստական բանականությունը չի կարող ունենալ․

«Արհեստական բանականությունը մարդու կողմից ստեղծված ամենապահպանողական բանն ա, ինքը հին սովորած բաները կարա վերաձևակերպի, դրանից խեր չկա։ Կամ կարա հին բաները նորովի կոմբինացնի ու նոր բան ստանա, բայց էդ նորին ես չեմ հավատում, էդ նորը վերապրված էմոցիաների արդյունք չի, ու մարդ ա պետք, որ վալիդացնի դա»:

Հ․Գ․՝ Զորիի ռեպ-քառատողը ChatGPT-ի մասին․

«ինչը չգիտես, բայց օբշի պիտի

ուղեղի հարցեր են, դու էլ նենց բիթի

բացում ես բռաուզեռը, չատ ջիպիտի

հույս ունես, որ յանի ժեշտը գիտի»։